Implan otak membaca pikiran mengubah pikiran menjadi berbicara hampir secara instan: 'terobosan'

Implan otak yang menggunakan kecerdasan buatan (AI) hampir dapat secara instan memecahkan kode pikiran seseorang dan mengalirkannya melalui pembicara, penelitian baru menunjukkan. Ini adalah pertama kalinya para peneliti mencapai streaming otak-ke-suara yang hampir sinkron.

Teknologi membaca pikiran eksperimental dirancang untuk memberikan suara sintetis kepada orang-orang dengan kelumpuhan parah yang tidak dapat berbicara. Ini bekerja dengan meletakkan elektroda ke permukaan otak sebagai bagian dari implan yang disebut a Neuroprosthesisyang memungkinkan para ilmuwan untuk mengidentifikasi dan menafsirkan sinyal bicara.

Antarmuka Komputer Otak (BCI) menggunakan AI untuk memecahkan kode sinyal saraf dan dapat mengalirkan ucapan yang dimaksud dari otak secara dekat dengan waktu nyata, menurut pernyataan yang dikeluarkan oleh University of California (UC), Berkeley. Tim sebelumnya meluncurkan versi sebelumnya Teknologi pada tahun 2023, tetapi versi baru lebih cepat dan kurang robot.

“Pendekatan streaming kami membawa kapasitas decoding perangkat cepat yang sama dengan perangkat seperti Alexa dan Siri ke neuroprostheses,” peneliti co-principal studi Gopala AnumanchipalliAsisten Profesor Teknik Listrik dan Ilmu Komputer di UC Berkeley, mengatakan dalam pernyataan itu. “Menggunakan jenis algoritma yang serupa, kami menemukan bahwa kami dapat memecahkan kode data saraf dan, untuk pertama kalinya, memungkinkan streaming suara yang hampir sinkron.”

Anumanchipalli dan rekan -rekannya berbagi temuan mereka dalam sebuah penelitian yang diterbitkan Senin (31 Maret) di jurnal Neuroscience Alam.

Orang pertama yang mengadili teknologi ini, yang diidentifikasi sebagai Ann, menderita stroke pada tahun 2005 yang membuatnya lumpuh parah dan tidak dapat berbicara. Sejak itu ia memungkinkan para peneliti untuk menanamkan 253 elektroda ke otaknya untuk memantau bagian otak kami yang mengendalikan ucapan – yang disebut motor cortex – untuk membantu mengembangkan teknologi bicara sintetis.

“Kami pada dasarnya sedang mencegat sinyal di mana pemikiran diterjemahkan ke dalam artikulasi dan di tengah kontrol motorik itu,” kata penulis co-lead studi Thoole One Cho, Seorang mahasiswa doktoral di bidang teknik elektro dan ilmu komputer di UC Berkeley, mengatakan dalam pernyataan itu. “Jadi, apa yang kita decoding adalah setelah pemikiran terjadi, setelah kita memutuskan apa yang harus dikatakan, setelah kita memutuskan kata-kata apa yang akan digunakan dan bagaimana memindahkan otot-otot vokal kita.”

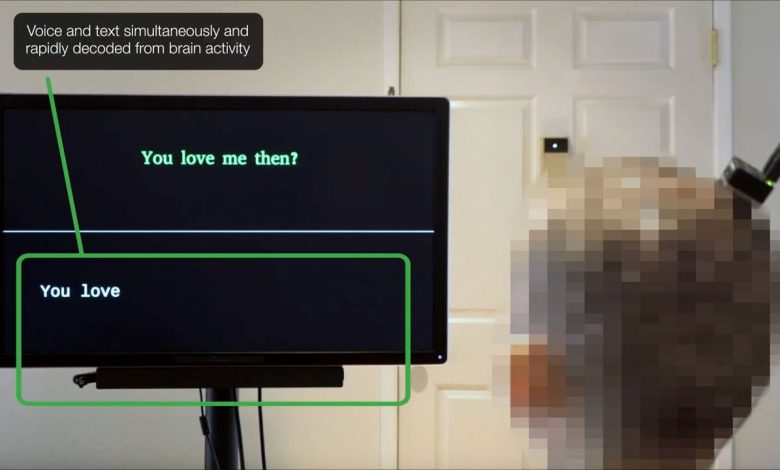

AI mendekode data yang diambil sampelnya dengan implan untuk membantu mengubah aktivitas saraf menjadi pidato sintetis. Tim melatih algoritma AI mereka dengan meminta Ann diam -diam mencoba berbicara kalimat yang muncul di layar di depannya, dan kemudian dengan mencocokkan aktivitas saraf dengan kata -kata yang ingin dia katakan.

Sistem sampel otak menandakan setiap 80 milidetik (0,08 detik) dan dapat mendeteksi kata -kata dan mengubahnya menjadi ucapan dengan penundaan hingga sekitar 3 detik, menurut penelitian. Itu sedikit lambat dibandingkan dengan percakapan normal, tetapi lebih cepat dari versi sebelumnya, yang memiliki keterlambatan sekitar 8 detik dan hanya bisa memproses seluruh kalimat.

Sistem baru mendapat manfaat dari mengonversi jendela yang lebih pendek dari aktivitas saraf daripada yang lama, sehingga dapat terus memproses kata -kata individu daripada menunggu kalimat yang sudah selesai. Para peneliti mengatakan studi baru ini merupakan langkah menuju pencapaian pidato sintetis yang terdengar lebih alami dengan BCIS.

“Kerangka kerja bukti konsep ini cukup terobosan,” kata Cho. “Kami optimis bahwa kami sekarang dapat membuat kemajuan di setiap level. Di sisi teknik, misalnya, kami akan terus mendorong algoritma untuk melihat bagaimana kami dapat menghasilkan ucapan dengan lebih baik dan lebih cepat.”